Πριν από μερικούς μήνες, εκατομμύρια τηλεθεατές στη Νότια Κορέα παρακολουθούσαν το δελτίο ειδήσεων στο κανάλι MBN. Η παρουσιάστρια του δελτίου, Kim Joo-Ha, άρχισε να διαβάζει τους τίτλους της ημέρας. Ήταν μια σχετικά φυσιολογική μέρα στα τέλη του 2020, με ειδήσεις σχετικές με τον Covid-19 να πρωταγωνιστούν.

Ωστόσο, το συγκεκριμένο δελτίο δεν ήταν καθόλου φυσιολογικό, καθώς η Kim Joo-Ha δεν ήταν πραγματικά στην οθόνη. Είχε αντικατασταθεί από μια deepfake εκδοχή της – ένα αντίγραφο, δημιούργημα υπολογιστή που κατάφερε να αντικατοπτρίσει τέλεια τη φωνή, τις χειρονομίες και τις εκφράσεις του προσώπου της.

Οι θεατές είχαν ενημερωθεί εκ των προτέρων ότι αυτό θα συνέβαινε, και οι αντιδράσεις των πολιτών ήταν μεικτές, όπως καταγράφηκαν από τα μέσα ενημέρωσης της Νότιας Κορέας. Ενώ μια ομάδα τηλεθεατών έμειναν έκπληκτοι από το πόσο ρεαλιστικό ήταν, άλλοι εξέφρασαν την ανησυχία τους σχετικά με το πώς μπορεί να χρησιμοποιηθεί η νέα τεχνολογία στο μέλλον.

Τον τελευταίο καιρό υπάρχει έντονος διάλογος για τα deepfake. Στο μυαλό της πλειοψηφίας του κόσμου, τα deepfake έχουν συσχετιστεί με πλαστά βίντεο διασημοτήτων ή πολιτικών αρχηγών. Και όχι αδίκως, δεδομένου το χαμού που είχε προκαλέσει πολιτική διαφήμιση της αμερικανικής ΜΚΟ RepresentUs, η οποία δημιούργησε πολιτικά σποτ με deepfake εκδοχές του Ρώσου προέδρου Πούτιν και του Βορειοκορεάτη δικτάτορα Κιμ Γιονγκ Ουν. Viral έγινε, επίσης, ένα -ανησυχητικά αληθοφανές- deepfake βίντεο του Tom Cruise.

Τι είναι το deepfake

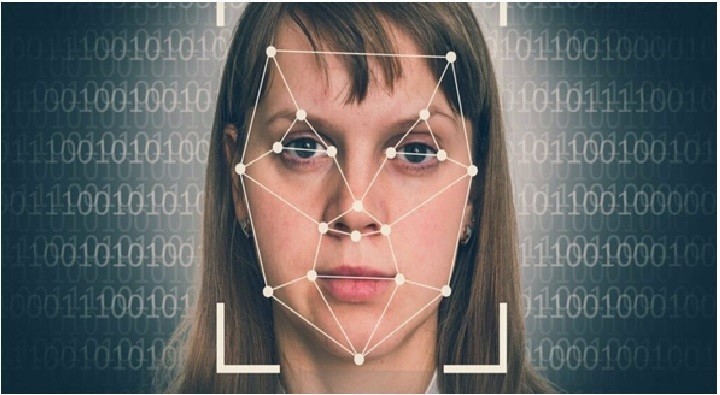

Το deepfake βασίζεται στην ικανότητα της τεχνολογίας τεχνητής νοημοσύνης να αντιγράφει με ακρίβεια τη φωνή, τις λεπτομέρειες του προσώπου και του σώματος και τις κινήσεις ενός ατόμου και να τα αναπαριστά με τρόπο που καθιστά ιδιαίτερα δύσκολη τη διάκριση πραγματικού και πλαστού.

Έτσι, είναι δυνατό να παραχθούν βίντεο, όπου κάποιος, που μπορεί να μην είναι καν εν ζωή, φαίνεται να λέει ή να κάνει πράγματα που ουδέποτε είπε ή έκανε. Χαρακτηριστικό παράδειγμα το πρόσφατο video clip του τραγουδιστή Snoop Dog, στο οποίο εμφανίζεται και ο αποβιώσας ράπερ Tupac.

Κερδίζουν έδαφος στο εμπόριο

Παρά τις αρνητικές πτυχές που περιβάλλουν τον όρο deepfake, η τεχνολογία αυτή κερδίζει όλο και μεγαλύτερο έδαφος στον εμπορικό κόσμο. Ο Mike Price, επικεφαλής της τεχνολογίας της ZeroFox, μιας αμερικανικής εταιρείας ασφάλειας στον κυβερνοχώρο, λέει ότι η εμπορική χρήση τους «αυξάνεται σημαντικά χρόνο με το χρόνο».

Η χρήση των deepfake αυξάνεται ραγδαία σε τομείς όπως οι ειδήσεις, η ψυχαγωγία και η εκπαίδευση, με την τεχνολογία να γίνεται όλο και πιο εξελιγμένη.

Μια από τις πρώτες εταιρείες που «αγκάλιασε» τα deepfake είναι η Synthesia, η οποία δημιουργεί εκπαιδευτικά βίντεο για εταιρείες, όπως η διαφημιστική εταιρεία WPP και η εταιρεία συμβούλων επιχειρήσεων Accenture.

Ο διευθύνων σύμβουλος της Synthesia, Victor Riparbelli, αναφέρει ότι με τη νέα αυτή τεχνολογία δίνεται η δυνατότητα σεπολυεθνικές να δημιουργούν εύκολα βίντεο σε διαφορετικές γλώσσες, όπως ενδοεταιρεικά επιμορφωτικά σεμινάρια. «Η τεχνολογία των deepfake συμβάλει στην παραγωγή βίντεο με μικρό κόστος και σε ελάχιστο χρόνο. Αυτό αναδεικνύει μια από τις πολλές δυνατότητες των deepfake να χρησιμοποιηθούν για καλό σκοπό.».

Ένα βίντεο εκπαιδευτικής χρήσης, που προετοιμάζεται από το Ίδρυμα Shoah του Πανεπιστημίου της Νότιας Καλιφόρνιας, αναδεικνύει άλλη μια εντυπωσιακή δυνατότητα των deepfake. Το ντοκιμαντέρ, που θα φιλοξενεί περισσότερες από 55.000 μαρτυρίες από επιζώντες του Ολοκαυτώματος, θα επιτρέπει στους θεατές να ρωτάνε τους επιζώντες και να λαμβάνουν απαντήσεις σε πραγματικό χρόνο.

«Αυτό είναι το μέλλον της δημιουργίας περιεχομένου», λέει ο διευθύνων σύμβουλος της Synthesia, Victor Riparbelli.

Η σκοτεινή πλευρά των deepfake

Ο Chad Steelberg, διευθύνων σύμβουλος της Veritone, ενός παρόχου τεχνολογίας τεχνητής νοημοσύνης στις ΗΠΑ, επισημαίνει ότι η αυξανόμενη ανησυχία για τους κινδύνους που συνδέονται με τα deepfake αποτρέπει τις επενδύσεις σε νόμιμες και εμπορικές χρήσεις της τεχνολογίας.

Ο Λίλιαν Έντουαρντς, καθηγητής Νομικής στη Νομική Σχολή του Newcastle, αναφέρεται σε ένα ζήτημα που ανακύπτει από την εμπορική χρήση των deepfake, και αυτό είναι η πνευματική ιδιοκτησία των βίντεο, σε ποιον δηλαδή ανήκουν. «Για παράδειγμα, γίνεται μεγάλη συζήτηση για το αν η οικογένεια ενός νεκρού ατόμου, όπως ο ο Steve Mc Queen ή ο Tupac, πάνω στον οποίο δημιουργείται ένα βίντεο, πρέπει να κατέχει τα δικαιώματα και να εισπράττει εισόδημα από αυτό», λέει.

Χωρίς αμφιβολία τα deepfake είναι άρρηκτα συνδεδεμένα στο μυαλό των ανθρώπων με τα fake news και τη ρητορική μίσους, ένα ζήτημα με το οποίο ασχολήθηκε η Ντέμπορα Τζόνσον, καθηγήτρια εφαρμοσμένης δεοντολογίας στο Πανεπιστήμιο της Βιρτζίνια. «Τα Deepfake ενισχύουν το πρόβλημα της παραπληροφόρησης που υπονομεύει την εμπιστοσύνη μας στην οπτική εμπειρία – δεν μπορούμε πλέον να εμπιστευόμαστε αυτά που βλέπουμε και ακούμε στο διαδίκτυο. Η ενημέρωση είναι η απλούστερη και πιο σημαντική εγγύηση για τα deepfake – εάν οι θεατές γνωρίζουν ότι αυτό που βλέπουν έχει κατασκευαστεί, είναι λιγότερο πιθανό να εξαπατηθούν».

Πρέπει να τεθούν όρια

Σύμφωνα με την ερευνήτρια στο Πανεπιστήμιο της Οξφόρδης, Sandra Wachter, η τεχνολογία deepfake «προχωρά μπροστά». «Δεν πρέπει να επικρατήσει ο φόβος γύρω από την τεχνολογία των deepfake. Πρέπει απλά να υπάρχουν όρια. Σαφώς, πρέπει να θεσπιστούν νόμοι για την καταπολέμηση των κινδύνων, όπως η ρητορική μίσους και οι παραπλανητικές ειδήσεις. Αλλά δεν γίνεται να απαγορεύσουμε εντελώς τη σάτιρα ή την ελευθερία έκφρασης. Η αυξανόμενη εμπορική χρήση αυτής της τεχνολογίας είναι πολύ ελπιδοφόρα».

Η παγκόσμια νομική κοινότητα έχει ήδη αρχίσει την προσπάθεια νομοθετικής καταπολέμησης των κινδύνων που εγκυμονούν τα deepfake. Για παράδειγμα, η Βιρτζίνια έγινε η πρώτη πολιτεία της Αμερικής που επέβαλε ποινικές κυρώσεις για τη δημιουργία deepfake για πορνογραφικούς σκοπούς ελλείψει συναίνεσης, ενώ στην Καλιφόρνια έχουν ψηφιστεί δύο νομοσχέδια που καθιστούν παράνομη την αναπαράσταση πολιτικών υποψηφίων εντός 60 ημερών από τις εκλογές.

Τη σκυτάλη παίρνει η Ευρωπαϊκή Ένωση, η οποία αν και δεν έχει θεσπίσει ακόμα ειδικό νόμο, στοχεύει στην καταστολή της διαδικτυακής παραπληροφόρησης μέσω deepfake και όχι μόνο, θέτοντας σε ισχύ έναν αυτορρυθμιστικό Κώδικα Δεοντολογίας.

Όποια κι αν είναι η εξέλιξη για την τεχνολογία των deepfake, το μόνο σίγουρο είναι ότι επιφυλάσσει πολλές εκπλήξεις για το μέλλον, θετικές ή αρνητικές.

Διαβάστε ακόμη:

Αποζημιώσεις ενοικίων: Λήγει σήμερα η προθεσμία για τις δηλώσεις Μαρτίου – Δεκεμβρίου 2020